Индекс цитирования – инструмент, а не цель!

11.04.2011

В последнее время все больше говорят о необходимости использования численных показателей – индекса цитирования и импакт-фактора при оценке результатов научных исследований и научных периодических изданий

В последнее время все больше говорят о необходимости использования численных показателей – индекса цитирования и импакт-фактора при оценке результатов научных исследований и научных периодических изданий. Утверждают, что по этим критериям лучше всего сопоставлять уровень научных исследований разных организаций или отдельных исследователей, определять приоритеты в их финансовой поддержке. Раздаются, однако, и другие голоса, указывающие на неоднозначное влияние на науку как численных показателей, так и всей системы наукометрии, развивающейся сейчас за рубежом, в основном в США.

Редакция попросила изложить свою точку зрения на проблему вице-президента РАН, академика В.В.Козлова и доктора философских наук, заведующую отделом Института философии РАН Н.В.Мотрошилову.Читателю, несомненно, будет интересно сопоставить позицию наших ученых со взглядом на проблему американских коллег - Дугласа Арнольда и Кристин Фаулер, статью которых «Гнусные цифры» также предлагаем вашему вниманию.

- Валерий Васильевич, есть ли польза от наукометрии?

- Важность наукометрии нельзя не признать: она позволяет понимать по публикациям по той или иной теме - каковы тенденции, какие темы особенно популярны, какие, наоборот, утрачивают популярность. С этой точки зрения интерес представляют индексы цитирования ученых, в том числе индекс Хирша (h-index), а также т.н. импакт-факторы, характеризующие деятельность научных журналов. Но абсолютизировать эти данные и принимать решения, основываясь только на них, совершенно недопустимо.

- Почему?

- В России эта деятельность, как справедливо пишет Нелли Васильевна Мотрошилова, не так развита, как на Западе, и особенно в США. Там, действительно, есть частные структуры, которые этим занимаются, т.е. фактически это бизнес в сфере науки. Так, Thomson Reuters Corporation уже многие годы составляет базы данных, сопоставляет, выстраивает системы, позволяющие вычислять индексы цитирования. Но в базы данных входят в основном те журналы, которые издаются на Западе и именно там являются распространенными, популярными. Российские же журналы охвачены этой системой не только не в полной мере, а, я бы сказал – совсем плохо.

Российской системы, подобной американской, к сожалению, не существует – то, что есть, лишь начинает работать, мы еще должны пройти большой путь. Соответственно, у нас нет и собственной базы данных, на основании которой мы могли бы получить более-менее объективные результаты.

Что же получается? В чьих руках система и база данных, те и диктуют моду, продвигают свои журналы и их авторов. А, кроме того - и об этом пишут наши американские коллеги Дуглас Арнольд и Кристин Фаулер - эти цифры на Западе зачастую несут элемент лукавства. Правильно говорят: пока какой-то критерий оценки деятельности явно не сформулирован, он является полезным, но как только он четко сформулирован - тут же начинаются попытки использовать его в своих интересах.

Взять индекс цитирования - т.е. количество ссылок на работы того или иного автора в публикациях других ученых. Этот автор, понимая, что данный параметр для него важен, порой начинает думать не столько о том, как написать выдающуюся работу, которая будет замечена мировым сообществом и все будут ее цитировать и ею восхищаться – такую работу написать, разумеется, трудно – он соображает в ином направлении: как сделать, чтобы на его работу было больше ссылок? И первая очевидная идея - договориться с друзьями и коллегами повышать научный рейтинг путем взаимных цитирований и упоминаний результатов друг друга. Это же касается и так называемых импакт-факторов журналов. В статье наших коллег Дугласа Арнольда и Кристин Фаулер убедительно и поучительно рассказано на примере известных нам журналов, как это делается. Разумеется, все это некрасиво и вряд ли можно оправдать с моральной точки зрения. Во множестве других случаев это, между прочим, также делается, просто не столь явно, как в приведенных примерах, а просто - на грани приличия и неприличия. И это также, конечно, не украшает наше научное сообщество.

Почему-то у нас, в России, властные структуры - я имею в виду, прежде всего, Министерство образования и науки РФ - прямо-таки настаивают, что российская наука, особенно фундаментальная, якобы, не так котируется на Западе, поскольку у наших ученых нет таких высоких индексов цитирования, а у наших отечественных журналов нет высоких импакт-факторов.

А отсюда вывод: с этим надо что-то делать, т.е., в частности, надо активно приглашать ученых с Запада – пусть, мол, они «поднимают» российскую науку. Это странный подход, и основан он на необъективной информации.

Академия наук, разумеется, не поддерживает такие подходы и считает, что в этих вопросах надо навести порядок. Если мы хотим иметь более-менее объективную картину по научным публикациям в России, значит, мы должны серьезно выстраивать у себя подобную информационную систему, которая, как я говорил, сегодня находится в зачаточном состоянии. Но, даже если бы она была развита, мы не можем принимать решения, основываясь лишь на этой информации, поскольку ее объективность под вопросом.

- В какой степени высказанная сейчас вами точка зрения является распространенной среди ученых?

- Любопытно, что не только те или иные наши западные коллеги персонально высказывают сомнения по поводу целесообразности широкого использования наукометрической деятельности в принятии решений по поводу оценки труда ученых, но такую позицию занимают и целые международные организации. В частности, Нелли Васильевна назвала Международную федерацию философских обществ. Я же, как математик, скажу, что и Международный математический союз на одном из своих конгрессов специально рассматривал вопрос о целесообразности учета индекса цитирования и импакт-факторов в математике.

И вот на что в этом обсуждении указывалось: индексы цитирования существенно зависят от области знания. Например, математиков в целом не так много по сравнению с общим числом физиков, а физиков значительно меньше, чем биологов, особенно, если мы возьмем их вместе с медиками. Поэтому индексы цитирования биологов и медиков больше, чем у физиков, а у физиков, соответственно, больше, чем у математиков.

То же касается и величин импакт-факторов журналов: по биологии они больше, чем в среднем по физике, а в физике – больше, чем в среднем по математике.

Но даже, если возьмем только математику, то и в ней также все будет зависеть от области знания. Специалистов по теории чисел не так много, как специалистов по динамическим системам, по дифференциальным уравнениям, а их, в свою очередь, меньше чем специалистов по теории вероятностей и математической статистике (поскольку вероятностные методы широко используются в приложениях). Т.е. абсолютное количество ученых в одних областях больше, чем в других. Поэтому, если уж оперировать численными показателями эффективности работы ученых, то такие «нюансы» надо непременно учитывать. Однако поскольку явно проявились тенденции, когда к подобным вопросам подходят бездумно, то Международный математический союз высказался против широкого использования наукометрических данных при оценке труда ученого.

- А как же в этом случае вообще возможна оценка труда ученого и научно-исследовательского института, как определить рейтинг или репутацию научного журнала?

- В кругах действующих ученых всегда известно - кто что сделал в науке, кто чего стоит. И в основе лежит (явная или неявная) экспертная оценка – мнение коллег, выражающееся различными способами. Можно, например, выявить, кто из ученых более охотно приглашается на различные международные научные конференции. Можно просто спросить у специалистов в той или иной области - кто из ныне живущих ученых сделал наиболее существенный вклад? Кстати, именно так отбирают круг претендентов на Нобелевскую премию - по множеству экспертов рассылают просьбу дать предложение по номинациям. Вот так, наверное, и можно наиболее объективно оценить вклад того или иного ученого.

Впрочем, и данный подход не универсален, поскольку в истории известно много примеров выдающихся и великих ученых, труды которых, к сожалению, не были признаны при их жизни, современники не разобрались. Поэтому вопрос о признании того или иного ученого имеет еще и продолжение во времени. Вспомним - Дмитрий Менделеев не стал Нобелевским лауреатом.

- То есть четкой и простой процедуры определения рейтинга ученого нет и быть не может?

- Есть еще одна точка зрения, я сам лично ее придерживаюсь, хотя, быть может, не все коллеги со мной согласятся. Задача ученых, всего сообщества, занятого фундаментальными исследованиями - раскрывать закономерности и законы природы и общества, получать новые знания. И, мне кажется, мы должны радоваться всему новому, интересному, что появляется в нашей науке – не только большим достижениям, но, быть может, и не таким значительным, но тоже заметным. Уважая труд всех наших ученых, коллег, надо радоваться и поддерживать каждого, кто этим занимается. А непременно настаивать – вот это мое, признавайте это, восхищайтесь моими достижениями – нескромно, да и не соответствует духу и принципам исследования природы и общества.

Конечно, ученые - люди со своим темпераментом, страстями, каждому хочется признания, и в жизни научных коллективов есть противоречия, которых вряд ли удастся избежать. Но ко всему этому мы должны относиться, во-первых, с пониманием и спокойствием, а, во-вторых, критически оценивая данные наукометрии. Они полезны, но абсолютизировать их не стоит.

- Пока мы рассматривали вопрос в ракурсе «ученый в научном сообществе», но ведь есть и иной ракурс – «наука в стратегическом курсе страны» и тут также можно говорить о пользе или вреде индексов цитирования...

- Министерство образования и науки РФ, конечно, увлекается этими, пришедшими с Запада наукометрическими подходами, не учитывая, что они не более, чем формальные подходы, что реальные выводы могут делаться только на уровне экспертных оценок. И действительно, можно и нужно задать вопрос: поможет ли нам слепое копирование подходов, культивируемых на Западе, в технологической модернизации России, важность которой признают сегодня политические лидеры нашего государства? И не приведет ли отвлечение на неэффективные методы просто к потере драгоценного исторического времени?

Правомерность такой постановки вопроса хорошо иллюстрирует совсем недавний пример, всем хорошо известный. Вспомним: наш Президент, Дмитрий Анатольевич Медведев настойчиво потребовал от руководства Министерства образования и науки РФ обратить внимание на подготовку инженеров в высших учебных заведениях. В самом деле, эта сфера выпала из поля зрения министерства, гораздо более популярными стали специальности юристов и экономистов - а где же инженеры? И как без них развивать технологическую базу страны? Постановка вопроса Президентом абсолютно справедлива.

И министерство сразу начало «рапортовать», что, мол, сейчас, во-первых, увеличим число мест в высших учебных заведениях инженерных специальностей, и, во-вторых, запретим этим вузам готовить юристов и экономистов. Это правильно, но разве не нужно было все это делать намного раньше? К тому же, нельзя не видеть и явную непоследовательность в действиях министерства.

Ведь можно, конечно, попытаться быстро поправить дела в высшей школе, но как ей быть без опоры на общеобразовательную среднюю школу? А в ней-то сегодня принципы функционирования старших классов подчинены сдаче ЕГЭ - Единого государственного экзамена. Обратим внимание на физику - она в системе ЕГЭ, как известно, является предметом по выбору. А поскольку она, прямо скажем - трудный предмет, то сегодня только 15% школьников выбирают ее как предмет сдачи ЕГЭ. Зададим резонный вопрос: возможно ли становиться техническим специалистом без знания физики? Нет. Так как же тогда понимать, что 35% мест в вузах – это места для подготовки инженеров? Получается, что 20% будущих абитуриентов технических вузов в школе всерьез физику не изучают – разве можно в этом случае говорить о повышении уровня подготовки инженеров?

Да, стране совершенно необходима технологическая модернизация, новые технологии. Но нам нужны собственные технологии и мы должны развивать собственную технологическую базу! А без своих кадров инженеров и ученых, без развития собственной фундаментальной науки мы далеко не продвинемся. Вряд ли правильно, если страна будет развиваться только на достижениях зарубежной науки и техники. Надо развивать свое! Разумеется, воспринимать все лучшее, что есть на Западе, но не копировать слепо подходы, которые там культивируются, в том числе и в отношении оценки результатов деятельности ученых.

Так что тема применения индексов цитирования для оценки труда ученых и научных коллективов – лишь фрагмент большого круга вопросов развития фундаментальной науки, новых технологий и образования, от которых впрямую зависит реализация технологической модернизации России, и которым, как мне кажется, к сожалению, сегодня уделяется недостаточно внимания у нас в стране.

Интервью доктора философских наук, заведующей отделом Института философии РАН Н.В.Мотрошиловой:

- Нелли Васильевна, говоря слово «наукометрия», одни скажут, что это что-то американское, другие же признаются, что ничего про это не знают. Но ведь жизнь уже требует практического применения наукометрии!

- Оговорюсь сразу: в нашем разговоре ограничимся только гуманитарными науками, о науках естественных я говорить не буду - здесь я не могу высказывать проверенных соображений. А то, что говорю о философии – в основном проверяла и подсчитывала.

Да, документы, предписывающие использовать количественные наукометрические методы для оценки эффективности научной деятельности ученые получают в целом ряде региональных Отделений РАН, в частности, в Москве. При этом нам предлагается считать критерием эффективности научных исследований те цифры и данные, которые суммируются в целом ряде зарубежных специальных наукометрических, библиометрических изданий.

Однако имеет место парадокс (подобное нередко случается в нашей стране): почти никто не знает, что это за издания, какого они характера, каковы принципы их работы, каково их отношение к тому, что происходит в нашей стране? Я специально спрашивала и обнаруживала – хотя люди мало или почти ничего не знают о наукометрии, они исходят как бы из общей презумпции: слышали, что за рубежом есть такие фирмы и специальные периодические издания, в которых учитывается то, что ученые разных стран, включая социо-гуманитариев, публикуют не в своих странах, а за рубежом, т.е. эти издания, подобно зеркалу, отражают такого рода активность ученых и их признание за рубежом. Я же называю эту систему «системой кривых зеркал», хотя признаю, что такой критерий – но только как частный и только как количественный – в отдельных случаях можно было бы принять, и это было бы неплохо. Однако в реальности возникает много сложностей. И потому нужно обязательно просвещать наше сообщество - чтобы люди знали, что это за издания, как они работают. В своей статье («Недоброкачественные сегменты наукометрии», Вестник РАН, №2, 2011) я подробно рассказываю об этих изданиях.

- Почему – «кривые зеркала»?

- Есть американская частная корпорация Thomson Reuters Corporation, которая уже много лет занимается подсчетом зарубежных публикаций и сетями цитирования. У этой фирмы есть базы данных - называются Web of Science, сокращенно WoS, и по этим данным ведется соответствующий подсчет. Тут для российских ученых, особенно социо-гуманитарного профиля, возникают изначальные трудности. Например, чтобы получить сведения о том, что имеется в WoS, нужно произвести очень дорогую подписку, исчисляемую десятками тысяч долларов. Такие подписки имеют, например, Высшая школа экономики, и, кажется РФФИ (точно не знаю), но институты РАН и университеты – не имеют. Т.о. первая трудность – это узнать, как они «нас подсчитали».

Предположим, однако, что мы преодолели эту трудность (я, во всяком случае, попыталась это сделать для себя). Но сразу же - следующая трудность: данные эти не динамичны, т.е. в начале года, например, вы не получаете оперативных сведений и если в 2011 году вам предлагают отчитаться за 2010-й и привести ссылки, то вам это не удастся - их еще объективно нет.

Но главное даже в другом: в правилах цитирования, в правилах подсчета, которые приняты в Thomson Reuters Corporation. А именно – не подсчитываются книги, а только статьи и лишь немногие из так называемых proceedings, т.е. публикаций по итогам конгрессов, симпозиумов и т.д.

Прибегну к образному сравнению: предположим, есть прибор, который бы улавливал движение по морям и океанам только маленьких и средних судов, но не замечал бы крупных судов - верна ли была бы, в этом случае, оценка того, каково движение по морям и океанам?

Смотрите: если бы мы стали так определять самые крупные фигуры, например, в истории философии, то в поле зрения не попали бы три кантовские «Критики», «Наука логики» Гегеля и т.д., в лучшем случае попали бы их маленькие статьи. А, наверное, самые плодовитые писатели статей числились бы в великих философах. Это, разумеется, абсурд по отношению к тем сложившимся гуманитарным культурам – в России, Германии, Франции, других европейских странах – которые основываются на крупных, фундаментальных работах.

Следующая трудность. Thomson Reuters Corporation – очень сильная корпорация и, действительно, масштабнее, чем она, никто сейчас не работает. Есть, например, еще одна система – Scopus, действующая пять лет: некоторые упоминают о ней, но по ней редко кода подсчитывают (в эту систему заглядывают разве что самые большие специалисты в наукометрии.) Значит, мы по существу имеем дело с монополизмом, который как данность преподносится другим странам. Нельзя, конечно, не признать, что американцы поступили довольно прозорливо: вложили деньги, заняли этот рынок и продолжают отстаивать здесь свои интересы.

Корпорация Thomson Reuters Corporation обсчитывает только журналы, причем довольно много – более десяти тысяч, но распределяются они на все научные дисциплины. В частности, на философию приходится 156 журналов. Что это за журналы? Безусловно – очень неплохие журналы и, как правило, международные. Но! – Две трети этих журналов издаются в США, в Англии и в Голландии. Спрóсите – почему в Голландии? Потому что там сосредоточены издатели, издательские корпорации, там издается много журналов – так исторически сложилось.

По журналам других стран корпорация ведет отбор – далеко, между прочим, не всех стран, но большинство стран все-таки в базе представлены – одним-двумя-тремя журналами. В России из философских журналов в перечень входит только журнал «Вопросы философии». Но нет, например, журналов из скандинавских стран. Финляндия – философская страна, а журналов от нее нет. Нет ни одного национального журнала из Польши! Однако представлены четыре журнала из Хорватии – я, например, не понимаю, почему так много! Т.е. налицо определенная несправедливость, и не только по отношению к России.

Получается: вы, например, регулярно публикуетесь в таком-то специальном журнале, однако оказываетесь в «слепой» зоне, потому что этот журнал не входит в перечень Thomson Reuters Corporation.

Как относиться к отбору изданий в тот перечень? Отбирать, конечно, нужно, но при этом надо осознавать и учитывать, что в результате имеется много искажений.

Я провела обследование, касающееся некоторых российских философов, которые исправно публикуются за рубежом. Профессор, доктор философских наук Мариетта Тиграновна Степанянц давно издает книги за рубежом, ее приглашают в США в качестве директора специальных семинаров. Есть она в сводке WoS? Да, но представлена там совсем не в той мере, не в том объеме, в котором реально работает.

Другой пример: в Институте философии РАН есть уникальная группа философов-востоковедов. По своему профилю – т.е. по китаеведению, индологии, арабской философии и т.д. – они публикуются в книгах, журналах, сборниках Лондона, Парижа, Нью-Дели, Пекина и так далее, т.е. в национальных или интернациональных журналах, но не входящих в перечень WoS. В перечне WoS есть журналы по востоковедению, но только те, которые издаются в США и в Англии. Т.о. целая масса периодических изданий этого профиля «пропадает». В результате, когда считают по базе Thomson Reuters Corporation, то получается, что за последние 15-18 лет эти наши философы публиковали за рубежом в среднем по одной-две-три статьи в год.

Мы видим искажения на целые порядки при сопоставлении с реальным количеством публикаций. У социологов, кстати, данное различие еще разительнее: число наших национальных социологических журналов, учитывающихся в сводках WoS, вообще равно нулю. Это же касается и экономистов; можно также привести и еще ряд других аналогичных примеров. Разумеется, подобной ситуацией решительно недовольны специалисты самых разных стран – Германии, Франции, Италии; сходные проблемы обсуждаются Международной федерацией философских обществ.

И совсем плохо, когда количественный инструментарий становится основанием для качественных выводов. В своей статье, например, я оспариваю вывод, который сделали наши отечественные наукометры А.В.Полетаев и И.М.Савельева, которые (под впечатлением того, что увидели в Thomson Reuters Corporation - всего две-три статьи наших философов в год) сделали вывод, что российская философия в международном сообществе представлена «мизерабельно», более того, растиражировали и этот численный показатель, и свой вывод. Любопытно при этом, что как раз они сами ранее в своих публикациях указывали на ряд ограниченностей в системе WoS (и я на их суждения опиралась). А потом, словно об этом начисто забыли, провозгласив тезис о «мизерабельном представительстве» российской философии.

- А на самом деле – каково это представительство?

- Я, наоборот, прихожу к выводу о серьезном продвижении вперед российской философии как раз в смысле представительства в международном научном сообществе. И в трудных условиях 90-х годов, и в первом десятилетии XXI века российская философия совершила в этом отношении заметный подъем. В упомянутой выше своей статье я подробно анализирую эту ситуацию в качественном отношении. У нас выполняются долговременные международные проекты, причем как с традиционно «философскими» странами Европы, так и, конечно, с США, с восточными странами. Это – крупные проекты. Если бы мы были «мизерабельными», кто бы нас в такие проекты приглашал? За последнее время целый ряд наших известных философов получили определенный статус в зарубежных странах - и как издатели коллективных сочинений, и как доктора honoris causa, и как участники международных редколлегий очень серьезных журналов и книжных серий (причем, некоторые наши философы – участники даже не одной, а нескольких международных редколлегий). В ряде случаев нам поручают издавать книги в великолепных солидных зарубежных издательствах, в этом случае мы - editors (по-немецки – Herausgeber), и это очень почетно.

Сотрудниками Института философии РАН издаются приблизительно 40-50 зарубежных публикаций в год. При этом российская философия отнюдь не исчерпывается Институтом философии РАН, у нас есть университеты, да какие университеты! Если все это суммировать вместе, то получится, что философское сообщество страны публикует, может быть, сотни статей в престижных международных книгах и журналах.

Можно составить внушительный список таких философов в нашей стране. В него входях, кстати, и блестящие молодые ученые. В самом деле: если сотрудника Университета дружбы народов Петра Резвых приглашают в Мюнхен издавать неопубликованные рукописи Шеллинга – какое еще нужно признание? Но ведь в материалы WoS подобные факты не входят!

В честь 80-летия нашего Института философии РАН (2009 г.) мы получили множество отзывов от "первых лиц" мировой философии. На торжествах по этому поводу у нас в гостях был Юрген Хабермас, который выступил на нашей конференции – разве это не факт признания?

- А что вообще такое - эффективность социальных наук, в частности, философии?

- У нас, сотрудников академической философской науки, есть немало разных предложений. Например, я сейчас занимаюсь проблемами цивилизации и варварства - ясно, что варварство грозит современной цивилизации, более того, варварство, одичание грозит и нашей стране. Есть и предложения по поводу того, как это предотвратить - но кому их отдать? Кто интересуется предложениями, идущими от общественных наук?

В истории, кстати, довольно часто предложения, идеи философии получали отклик только через века. Вспомним: в XVII веке была выработана система прав и свобод человека, которая пришла из философии; ее разработали Локк и другие философы. И отнюдь не сразу эта идея появилась в конституциях государств, а только через многие годы, например, Томас Джефферсон, третий президент США, адаптировал эту систему для американской Конституции. Иными словами, «история терпелива», она дает философским идеям шанс вызреть, проникнуть в умы, найти своих посредников – таких образованных политиков как Джефферсон. И потом эти идеи идут дальше, дальше, дальше, реализуясь в жизни общества. И, кстати, сегодня есть похожие примеры: например, упомянутый Юрген Хабермас является одним из конструкторов идеи европейского единства. Словом, по большому счету, критерий качества устанавливает сообщество и время; если же нужно оперативно определить качество какими-то критериями, то оно во всех случаях может быть выборочно установлено, подтверждено, в том числе и международным сообществом.

Я готова представить многие доказательства, которые позволят утверждать: мы не должны впрямую и однозначно зависеть ни в оценках эффективности труда, ни, тем более, в оплате и т.д. от одних зарубежных систем. Если их и использовать, то при учете многих дополнений и поправок.

- Может, надо создать подобную российскую систему?

- Пока такая российская система, сопоставимая с Thomson Reuters Corporation – по охвату, по колоссальным затрачиваемым средствам – не возникла. Где-то лет пять назад стартовала система РИНЦ – российский индекс научного цитирования, по ней уже производятся какие-то подсчеты. Мы, например, в Институте философии решили: надо знать – что и как там подсчитывается и из этого тоже делать выводы. Но пока система РИНЦ еще в самом начале своей деятельности. По крайней мере, однозначно основывать на ней критерии цитирования и, соответственно, выдвигать далекоидущие требования к ученым, по-моему, абсолютно преждевременно. Неплохо было бы учредить в Академии наук свою наукометрическую службу, но это очень дорого стоит. Не случайно в Thomson Reuters Corporation берут за подписку такие большие деньги – они окупают свои вложения, которые, как я говорила, очень большие. Если мы, научные сотрудники, получаем в виде зарплаты маленькие деньги, то я не верю, что с системой наукометрии может быть обеспечен прорыв, тем более не верю, что кому-то удастся доказать соответствующим инстанциям, что это так важно.

Да, количественные исследования в области измерения эффективности научных исследований возможны и необходимы, но это сложное специальное дело. Мы не в состоянии сейчас по поводу каждой цифры призвать некого добросовестного наукометра, который сделает систему коэффициентов и поправок и скажет: вот это обосновано достаточно, а это - недостаточно. Хотя специальность, которой ранее в научном сообществе мы пренебрегали - наукометрия, библиометрия - в нынешних условиях приобретает большое значение. Вот, например, очень правильно поступили в Высшей школе экономики, сделав заместителем директора библиотеки специалиста В.В.Пислякова, занимающегося именно данными вопросами. Его должность называется – зам. директора по управлению электронными ресурсами. И он на профессиональном уровне отлеживает, как специалисты Высшей школы экономики представлены в сетях цитирования. Безусловно, это полезно!

- Однако, может быть, постановка вопроса об индексах цитирования не случайна: те, кто выделяют деньги на фундаментальные научные исследования, вполне обоснованно желают контролировать, как они тратятся.

- О каких деньгах речь? Я расписываюсь в ведомости в их получении, как и остальные сотрудники нашего института, и должна сказать, что на фоне инфляции, кризисов, постоянно растущих цен (причем растущих совсем не так, как объявляет официальная статистика) – разве это деньги! Что особенно относится к кандитам наук, к аспирантам (с нищенской стипендией), т.е. к молодым научным кадрам. Эти зарплаты для науки – своего рода оскорбление! При Институте философии РАН функционирует ГУГН - Государственный университет гуманитарных наук, т.е. мы соединяем преподавание с научно-исследовательской работой. В Институте философии я заведую отделом и сектором и одновременно в ГУГН заведую кафедрой истории философии. Мы добросовестно (а в некоторых случаях - на мировом уровне) преподаем историю философии, весь ее цикл. Вы знаете, какая у меня зарплата как у заведующего кафедрой? Три тысячи рублей! За эти деньги, извините, уважающая себя уборщица не махнет метлой. И за приблизительно такие же деньги работают другие преподаватели высокого класса. Это унизительно, недостойно страны и Академии наук. И плохо то, что мы уже привыкли к этому.

Значит, первое, что нужно ответить тем, кто спешит с индексами цитирования из опасения, что мы нерационально расходуем выделяемые государством деньги: мы стараемся делать свое дело – и не в соответствии с тем, как нам платят! Ученые – в РАН, и за ее пределами – по сути дела многое делают почти бесплатно…

Ладно, предположим, действительно - нужно проконтролировать, как мы работаем за эти деньги. Можно предложить объективные показатели, поскольку все это выражается в цифрах. Если взять исследовательскую работу, то научные сотрудники постоянно представляют отчеты, которые подкрепляются «материально», например – монография, коллективная монография, ряд статей (при этом, кстати, издательства не платят почти никаких или просто никаких гонораров).

У нас, в Институте философии РАН, за год публикуется примерно 120 индивидуальных и коллективных монографий и более полутора тысяч статей. Если разделить данное число на количество сотрудников, которые эти работы публикуют - это много! Если же разделить на количество всех сотрудников, все равно получится много. А если кто-то захочет сделать проверку по качеству выборочно – это можно сделать, в частности, с помощью зарубежных отзывов.

Недавно что под моей редакцией и под редакцией известного кантоведа из Германии Норберта Хинске в престижнейшем издательстве Фроманн-Хольцбог вышла книга «Российское кантоведение сегодня». Можно ли это считать знаком качества? Можно, и подобных примеров у нас немало. Проверить качество на основании экспертизы, на основании тех или иных отзывов, выборочных или сплошных проверок – всегда можно и мы, кстати, сами кое-что выбраковываем, далеко не все публикуем. У нас есть журналы, Ежегодники, и отнюдь не всякая статья, что туда поступает, печатается.

У нас в Институте философии РАН каждый год публикуются отчеты за прошедший год, в том числе там отражаются и зарубежные публикации (это все проверено, никто ничего просто из головы не напишет). И по этим отчетам видно: только в одном Институте философии мы имеем самое меньшее 30-40 зарубежных публикаций в год, а в отдельные годы гораздо больше – 60-80.

- Вы отвергаете индекс цитирования?

- Из сказанного, мне кажется, может быть такой практический вывод: индекс цитирования, взятый из зарубежных подсчетов – дело полезное, обращать внимание на него нужно, но со множеством поправок и коэффициентов. И уж совсем нельзя торопиться с их практическим внедрением, во всяком случае – в нашей стране, где пока нет своей такой системы. В противном случае, превращая средства в цель, мы можем «наломать дров», многое загубить, а это неправильно. Особенно неблагоприятным и для науки в целом, и, в частности, для социо-гуманитарных дисциплин, было бы превращение индексов цитирования в основания каких-либо министерских или академических программ.

Вот приходит чиновник и говорит: надо считать импакт-фактор. Его спрашивают – а что такое импакт-фактор? Он говорит – я не знаю, но можно спросить у специалистов. Вот понимаете – какая здесь складывается цепь нечеткостей и недоразумений…

В свое время, в конце 60-х – начале 70-х годов прошлого века, от социологии науки отпочковалось направление, как раз связанное с цитатами и ссылками. Роберт Кинг Мертон – основатель и главный авторитет в социологии науки – сразу сказал, что ссылки и цитаты – нечто очень важное, что они позволяют понять, как одни ученые оценивают достижения других ученых. В 1972 году Роберт Мертон вместе со своей ученицей Гарриет Цукерман написал одну из своих самых лучших конкретных работ – о проблеме возраста в науке. В этой работе приводятся, в том числе, данные блестящего исследования Гарриет Цукерман, которое она выполнила, интервьюируя Нобелевских лауреатов. В частности, отвечая на вопросы Гарриет, они подчеркивали, как важно для ученых признание друг друга. (Один лауреат Нобелевской премии даже сказал: ну что такое Нобелевская премия, это, конечно, хорошо, но вот мой друг профессор Рабинович меня даже не поздравил с ней, он ее не признает, хотя это для меня очень больно…) Но вообще-то взаимное признание ученых – на самом деле очень важная вещь. Правда, индексами цитирования, вопреки предрассудкам, признание отражается вовсе не точно – тут очень много всем понятных случайностей и отклонений.

Как раз в упомянутой работе Роберт Мертон, откликаясь на первые этапы применения цитатного индекса, подсчетов ссылок и сносок, сказал – это важно, но здесь только инструмент! Инструмент, который нельзя превращать ни в цель, ни тем более в самоцель! И надо же, в своем предупреждении Роберт Мертон как в воду глядел: деятельность по составлению цитатного индекса сегодня грозит, от чего предостерегал Мертон, «отбиться от рук» – количественные данные мы спешим отждествить с качеством, что совершенно неправильно.

Мне также кажется: вопрос этот вообще не надо слишком усложнять, он легко решается, в том числе, конечно, и с помощью количественных показателей. Но только взятыми не из одних американских журналов. В частности, не следует пренебрегать нашими собственными отчетами. Каждый университет, каждый институт Академии наук имеет свою отчетность, свои сайты. Если же хотите в качестве одного из критериев взять международное признание (это можно и нужно делать!), то оно тоже имеется и так или иначе документируется. Короче говоря, это вопрос не такой уж трудный, а главное, он не чисто количественный, тем более не определяемый исключительно по данным по Thomson Reuters Corporation.

Беседовал Сергей Шаракшанэ

***

Гнусные цифры

Дуглас Арнольд и Кристин Фаулер*

Перевод: Сергей Кузнецов, ИСП РАН

Оригинал: Douglas N. Arnold, Kristine K. Fowler. Nefarious Numbers. arXiv.org, Cornell University Library, eprint, last revised 17 Nov 2010 (this version, v4)

Широко распространено использование импакт-фактора в качестве показателя качества журнала. Импакт-факторы применяются в библиотеках при принятии решений о подписке на периодические издания; исследователями, решающими, где стоит публиковаться и что стоит читать; университетскими рекомендательными комитетами, работающими в предположении, что публикация в журнале с более высоким значением импакт-фактора лучше характеризует специалиста; редакторами и издателями как средство оценки и продвижения своих журналов. Импакт-фактор для журнала в заданном году вычисляется ISI (Thomson Reuters) как среднее число появившихся в этом году ссылок на статьи данного журнала, опубликованные за два предыдущих года. Этот показатель подвергается критике с самых разных позиций1,2,3,4:

• Распределение ссылок на журнал не определяет его качество.

• Импакт-фактор – это грубая статистика, доносящая только часть информации о распределении ссылок.

• Эта статистика дефектна. С одной стороны, распределение ссылок по статьям является сильно скошенным, так что усреднение по всем статьям журнала обычно бывает недостоверным. С другой стороны, в импакт-факторе учитываются ссылки, появившиеся только за два первых года после публикации (недостаток, особенно существенный для математики, где около 90% ссылок появляется позже).

• Используемая база данных дефектна, содержит ошибки и включает предвзятую подборку журналов.

• Игнорируются многие побочные факторы, например, тип статьи (редакционные, обзорные статьи, письма в противопоставление оригинальным исследовательским статьям), наличие нескольких авторов, самоцитирование, язык публикации и т.д.

Несмотря на эти сложности, для многих оказывается неотразимой привлекательность импакт-фактора как отдельного, легко доступного числового показателя – не требующего сложного разбирательства или привлечения экспертов, но претендующего на характеристику качества журнала. В 2000 г. в статье для информационного бюллетеня для редакторов журналов Амин (Amin) и Мейд (Made) писали5, что "в последние годы импакт-фактор из невразумительного библиометрического показателя превратился в основной количественный показатель качества журнала, его исследовательских статей, исследователей, пишущих эти статьи, и даже организаций, в которых они работают". Обычным явлением для журналов стало распространение абсурдных объявлений, рекламирующих их импакт-факторы, подобных тому, которое было разослано по всему миру издательством World Scientific, издающим International Journal of Algebra and Computation (IJAC): "Импакт-фактор IJAC вырос с 0,414 в 2007 г. до 0,421 в 2008 г.! Поздравляем редакционный совет и авторов IJAC". В этом случае возрастание импакт-фактора на 1,7% представляет появление одной дополнительной ссылки на одну из 145 статей, опубликованных в журнале за два предыдущих года.

Из-за (неуместного) акцентирования важности импакт-факторов повышение значения этого показателя становится целью, к достижению которой стремятся редакторы и издатели журналов. В свою очередь, это становится новым источником проблем. Закон Гудхарта (Goodhart) предупреждает нас, что "когда достижение некоторого показателя становится целью, он перестает быть хорошим показателем"6. В точности так обстоит дело с импакт-факторами. Их ограниченная полезность еще больше компроментируется манипулированием импакт-факторами, такими действиями над этим пресловутым показателем качества журналов, которые увеличивают значение показателя, но не повышают (а в действительности – понижают) качество журналов.

Возможно множество форм манипулирования импакт-факторами. В 2007 г. в очерке о вредоносных воздействиях манипулирования импакт-факторами Макдональд (Macdonald) и Кэм (Kam)7 иронически заметили, что "благоразумный редактор выращивает кадры постоянных авторов, которые надежно способствуют повышению измеряемого качества журнала путем самоцитирования и цитирования друг друга". Широко распространены жалобы авторов рецензируемых рукописей, которых редакторы просят или вынуждают сослаться на другие статьи из того же журнала. Поскольку судьба публикации статьи автора зависит от решения редактора, эта практика граничит с вымогательством, даже если соответствующее пожелание подается в форме всего лишь намека. В большинстве случаев можно лишь догадываться о наличии подобного давления, но в 2005 г. уже поступали сообщения о явных случаях принуждения от Монастырского (Monastersky)8 в Chronicle of Higher Education и Бегли (Begley)9 в Wall Street Journal. Третий установившийся метод, за счет которого редакторы повышают значения импакт-факторов своих журналов, состоит в публикации обзорных заметок с большим числом ссылок на данный журнал. Например, главный редактор Journal of Gerontology A взял за правило писать и публиковать в каждом январском номере журнала обзорную статью, опирающуюся на публикации предыдущих двух лет; в 2004 г. 195 из 277 ссылок указывали на Journal of Gerontology A. Хотя ущерб, наносимый этими ненаучными методами научной литературе, время от времени вызывает тревогу, многие люди считают влияние подобных методов минимальным или полагают их настолько легко опознаваемыми, что оказываемым ими воздействием можно пренебречь. Для обоснования наличия причин для серьезного беспокойства следует привести контрпример.

Пример IJNSNS

В области прикладной математики имеется наглядный пример, позволяющий исследовать такое искажение импакт-фактора. В посдедние несколько лет в списках импакт-факторов категории "Mathematics, Applied" доминирует International Journal of Nonlinear Sciences and Numerical Simulation (IJNSNS). В 2006-2009 гг. этот журнал занимал первое место, обычно со значительным отрывом, а в 2005 г. находился на втором месте. Однако, как мы увидим, более тщательное изучение показывает, что IJNSNS никоим образом не является ведущим в данной области. Попробуем понять происхождение высокого значения его импакт-фактора.

В 2008 г. (этот год мы рассмотрим наиболее детально) импакт-фактор IJNSNS составлял 8,91, будучи, безусловно, наивысшим среди 175 журналов, относимых к категории прикладной математики в Отчетах о цитируемости журналов (Journal Citation Report, JCR) ISI. Для контроля мы также взглянем на два журнала из той же категории со вторым и третьим значениями импакт-фактора: Communications on Pure and Applied Mathematics (CPAM) и SIAM Review (SIREV), у которых в 2008 г. значения импакт-фактора составляли 3,69 и 2,80 соответственно. CPAM тесно связан с Курантовским институтом математических наук (Courant Institute of Mathematical Sciences), а SIREV является ведущим журналом Общества промышленной и прикладной математики (Society for Industrial and Applied Mathematics, SIAM)10. У обоих журналов имеется превосходная репутация.

Наилучшей альтернативой оценки качества журналов по показателям цитируемости является экспертная оценка. У метода тщательного ранжирования журналов экспертами имеются собственные потенциальные проблемы, но, скорее всего, он обеспечивает намного более точную и целостную оценку качества журнала, чем импакт-фактор и подобные ему показатели. В математике, как и во многих других областях, у исследователей близко совпадают мнения относительно того, какие журналы являются наилучшими в их специальности. Австралийский исследовательский совет (Australian Research Council) недавно опубликовал результаты такого сравнения, в котором качественно оценены 20000 рецензируемых журналов разных дисциплин. Этот список разрабатывался на основе широкомасштабного процесса рецензирования с участием научных академий (таких как Австралийская академия наук (Australian Academy of Science)), сообществ представителей отдельных дисциплин (таких как Австралийское математическое общество (Australian Mathematical Society)) и многих исследователей и экспертов11. Этот рейтинг будет использоваться в 2010 в рамках инициативы повышения уровня научных исследований в Австралии (Excellence in Research Australia, ERA), и его принято называть Списком журналов ERA 2010 (ERA 2010 Journal List). Рейтинг качества журнала, который оценивает его "общее качество", представляется одной из четырех оценок:

• A*: один из лучших в своей области или подобласти;

• A: очень высокое качество;

• B: надежная, хотя и не выдающаяся репутация;

• C: не отвечает критериям высокого уровня.

В список ERA вошли 170 из 175 журналов, которым в 2008 г. в JCR был назначен импакт-фактор в категории "Mathematics, Applied".

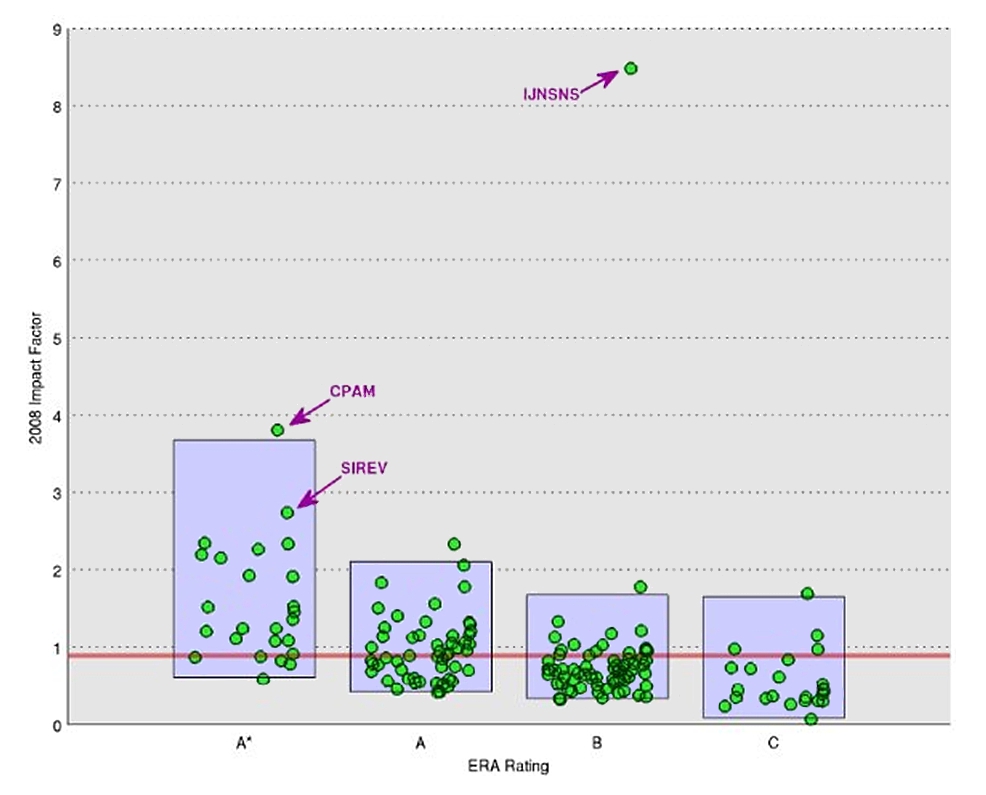

На рис. 1 показаны импакт-факторы журналов для каждого из четырех уровней рейтинга.

Рис. 1. Импакт-факторы в 2008 г. 170 журналов по прикладной математике, сгруппированные по своим уровням в рейтинге ERA. Для каждого уровня демонстрируется диапазон от 2,5-ой до 97,5-ой процентили, что позволяет охарактеризовать средние 95%. Горизонтальные позиции точек данных внутри уровней выбраны случайным образом для улучшения наглядности. Красная линия соответствует 20-ой процентили уровня A*.

Мы видим, что импакт-фактор слабо соответствует оценке экспертов. Имеется много примеров журналов с более высокими значениями импакт-фактора, чем у других журналов, занимающих в рейтинге позиции на один, два и даже на три уровня выше. Под красной линией находится 20% журналов уровня A*; примечательно, что более высокое значение импакт-фактора имеют 51% журналов уровня A, 23% журналов уровня B и даже 17% журналов уровня C. Самый экстремальный выброс демонстрирует IJNSNS, который, несмотря на относительно огромное значение импакт-фактора, находится не на первом или втором, а скорее на третьем уровне рейтинга. В рейтинге ERA наивысшую оценку A* получили 25 журналов. В этой группе представлено большинство журналов с наивысшими значениями импакт-фактора, включая CPAM и SIREV, но из 10 журналов с наивысшими значениями импакт-фактора два получили оценку A, и только IJNSNS попал в группу B. Всего имелось 53 журнала с рейтингом A и 69 журналов с рейтингом B. Если допустить, что IJNSNS является лучшим среди журналов группы B, то имелось бы 78 журналов с более высоким рейтингом ERA; если же он был бы худшим, то его рейтинг упал бы до 147. Коротко говоря, рейтинг ERA показывает, что IJNSNS не только не является лучшим журналом в области прикладной математики, но что его рейтинг находится где-то в диапазоне 75-150. Это удивительное несоответствие между репутацией журнала и его импакт-фактором нуждается в разъяснении.

Создание высокого импакт-фактора

На первом шаге на пути к пониманию происхождения высокого импакт-фактора IJNSNS мы взглянем на то, сколько авторов внесло существенный вклад в возрастание числа ссылок, и кто такие эти авторы. Автором, который больше всего ссылался на IJNSNS в 2008 г., является главный редактор журнала Цзы-Хуан Хе (Ji-Huan He), ссылавшийся на журнал (на статьи, вышедшие в течение предыдущего двухлетнего окна) 243 раза. На втором месте со 114 ссылками находится Д.Д. Ганжи (D.D. Ganji), который также является членом редакционного совета, и на третьем месте – региональный редактор Мохамед эль Наши (Mohamed El Naschie) с 58 ссылками. Совместно эти трое несут ответственность за 29% ссылок, учтенных в импакт-факторе. Для сравнения, три автора, больше других ссылавшиеся на SIREV, сослались на журнал всего 7, 4 и 4 раза соответственно, что составляет менее 12% учтенных ссылок, и ни один из этих авторов не участвовал в редактировании журнала. Для CPAM три автора, наиболее активно ссылавшиеся на журнал (9, 8 и 8 ссылок), привнесли около 7% от общего числа ссылок, и опять же никто из них не состоял в редакционном совете. Другое заметное явление представляет уровень концентрации ссылок на статьи, опубликованные в пределах двухлетнего окна, которое используется для подсчета импакт-фактора. Наш анализ ссылок, появившихся в 2008 г., на статьи, опубликованные после 2000 г., показывает, что 16% ссылок на CPAM относится к статьям этого двухлетнего окна, а в случае SIREV таких ссылок всего 8%. По сравнению с этим, 71,5% ссылок на IJNSNS ведут на статьи, опубликованные в пределах двухлетнего окна.

В табл. 1 мы показываем импакт-факторы этих трех журналов в 2008 г., а также модифицированные значения импакт-фактора, соответствующие среднему числу ссылок в 2008 г. на статьи, опубликованные в журналах не в 2006-2007 гг., а за предыдущие шесть лет. Поскольку время полураспада цитирования (время, за которое появляется половина от окончательного числа ссылок на статью) для прикладной математики составляет около 10 лет12, этот показатель, по крайней мере, имеет не меньше смысла, чем импакт-фактор. Кроме того, он независим (в отличие от пятилетнего импакт-фактора JCR), поскольку его период времени не перекрывается с тем, который используется при вычислении двухлетнего импакт-фактора. Заметим, что при использовании другого окна цитирования импакт-фактор IJNSNS стремительно падает, уменьшаясь в семь раз. В отличие от этого, импакт-фактор CPAM остается почти неизменным, а импакт-фактор SIREV заметно возрастает. Можно просто заметить, что, в отличие от контрольных образцов, в ссылках на IJNSNS в 2008 г. наблюдается значительное предпочтение статей, опубликованных точно в течение тех двух лет, которые используются при вычислении импакт-фактора.

Дальнейшее прозрение приходит при анализе журналов, а не авторов с большим числом ссылок. Учет журнальных самоцитирований в импакт-факторе часто подвергается критике, и в данном случае этот подход действительно используется. В 2008 г. в IJNSNS появились 102 ссылки на статьи этого же журнала, или 7% от общего числа ссылок, учитывавшихся при вычислении импакт-фактора. Соответствующими цифрами являются 1 ссылка (0,8%) для SIREV и 8 ссылок (2,4%) для CPAM. Расхождения для других недавних лет настолько же или еще более велики.

Однако наибольшее число ссылок на IJNSNS обеспечил Journal of Physics: Conference Series. В одном выпуске этого журнала содержались 294 ссылки на статьи, опубликованные в пределах окна подсчета импакт-фактора, что составляет более 20% от общего числа ссылок, на основе которых подсчитывался импакт-фактор. И что же это был за выпуск? Это были труды конференции, организованной главным редактором IJNSNS Хе в его родном университете. Он отвечал за рецензирование статей этого выпуска. На втором месте по числу ссылок на IJNSNS находился журнал Topological Methods in Nonlinear Analysis, который обеспечил 206 ссылок (14%), и все ссылки были размещены в одном выпуске журнала. Это был специальный выпуск с Цзы-Хуан Хе в качестве приглашенного редактора; его соредактор Лан Ксу (Lan Xu) также является членом редакционного совета IJNSNS. Сам Ц.-Х. Хе в этом выпуске опубликовал краткую статью из трех страниц текста и 30 ссылок. Из них 20 ссылок вели на статьи IJNSNS, опубликованные в пределах окна подсчета импакт-фактора. Среди оставшихся ссылок имелось 8 ссылок на Хе и 2 на Ксу.

Продолжая спускаться по списку журналов, активно ссылающихся на IJNSNS, можно обнаружить еще один подобный случай: 50 ссылок из одного выпуска Journal of Polymer Engineering (как и IJNSNS, он публикуется издательством Freund), приглашенными редакторами которого яляется та же пара Цзы-Хуан Хе и Лан Ксу. Однако третье место занимает журнал Chaos, Solitons & Fractals (CS&F) со 154 ссылками, разбросанными по разным номерам. Это опять такие ссылки, которые можно считать обусловленными влиянием или контролем редакторов. В 2008 г. Цзы-Хуан Хе состоял в редакционном совете CS&F, а главным редактором являлся Мохамед эль Наши, который также был соредактором IJNSNS. При обстоятельствах, получивших широкую огласку, весь редакционный совет CS&F недавно был заменен, но эль Наши остался соредактором IJNSNS.

Многие другие ссылки на IJNSNS появлялись в статьях, публикуемых в журналах, редактором которых являлся Хе; например, 40 ссылок обеспечил журнал Zeitschrift für Naturforschung A. Таких журналов слишком много, чтобы можно было их здесь перечислить, поскольку Хе исполнял редакторские функции более чем в 20 журналах (а теперь назван главным редактором еще четырех журналов недавно образованного издательства Asian Academic Publishers). Еще одним источником многочисленных ссылок являлись статьи, написанные другими редакторами IJNSNS. В общей сложности, совокупность таких родственных редакторам ссылок, для выявления которых требуется много времени, включает более 70% ссылок, использованных для вычисления импакт-фактора IJNSNS.

Библиометрия для отдельных личностей

Библиометрия также используется для оценки отдельных людей, статей, институтов и даже государств. Наукометрическая база данных Ключевых научных показателей (Essential Science Indicators), поддерживаемая компанией Thomson Reuters, рекламируется как средство для ранжирования "ведущих стран, журналов, ученых, статей и институтов в разных исследовательских областях". Однако эти показатели, главным образом, основываются на тех же данных о ссылках, которые используются для подсчета импакт-фактора, и такими показателями так же легко манипулировать (на самом деле, это делается одновременно). В специальном выпуске Journal of Physics: Conference Series, который редактировался Хе и собрал 243 ссылки на его журнал, также содержатся 353 ссылки на самого Хе. Он утверждает, что общее число ссылок на его статьи превышает 680013. Достижение даже половинного значения этого показателя считается весьма примечательным событием, о чем свидетельствует следующее сообщение, опубликованное на сайте ScienceWatch.com14: "По данным недавнего анализа Ключевых научных показателей от Thomson Scientific, профессор Цзы-Хуан Хе назван восходящей звездой в области компьютерной науки... В Web of Science зарегистрированы его 137 статей, которые к настоящему времени цитировались 3193 раза". В составе дюжины ученых из всех областей науки Хе упоминался в списках ESI "Наиболее активных исследований 2007-2008 гг." (Hottest Research of 2007-8) и "Наиболее активных исследований 2009 г."

Другим популярным показателем продуктивности исследователей, основанным на учете ссылок, является h-индекс (индекс Хирша (J. Hirsch)). H-индекс отдельного человека – это наибольшее число его (или ее) статей, каждая из которых цитировалась не менее того же числа раз. На этот показатель также действует закон Гудхарта. Хе утверждает, что его h-индекс составляет 39, в то время как сам Хирш оценивает среднее значение своего индекса для Нобелевских лауреатов в области физики как 3515. Оценки отдельных исследователей или журналов, основанные на учете ссылок, не заменяют экспертных оценок качества.

Заключительные размышления

Несмотря на многочисленные недостатки, импакт-фактор широко используется как показатель качества журналов и даже статей и авторов. Это порождает стимул для манипулирования данным показателем. Более того, можно значительно повысить значение импакт-фактора вообще без повышения качества журнала. Огромное влияние на импакт-фактор может иметь деятельность всего лишь нескольких заинтересованных людей, причем для разоблачения этой деятельности требуются значительные усилия. Мы, главным образом, обсуждали один экстремальный пример, но вряд ли стоит сомневаться в том, что подобные методы применяются во многих журналах, хотя и в меньшей степени (и из-за этого их труднее обнаружить). Совокупным результатом недостатков общего подхода и использования методов манипулирования является то, что импакт-фактор обеспечивает очень неточное представление о качестве журналов. В более общем смысле, ссылки, образующие основу импакт-фактора, и различные другие библиометрические показатели ненадежны по своей природе.

Эта плачевная ситуация имеет огромные последствия. Неверным способом назначаются награды, научная литература и предметные области деформируются, вокруг всего этого растет уровень скептицизма. Что же делать? Как и в самих научных исследованиях, нужно противиться искушению принятия упрощений, когда это может нанести серьезный ущерб точности. Порицаются ученые, поддающиеся искушению скрыть некоторые данные или исказить статистику, чтобы получить более понятные результаты. Мы должны придерживаться аналогичного уровня принципиальности при оценке результатов исследований. Администраторы, финансирующие организации, библиотекари и все прочие, кому требуются такие оценки, должны отказаться от упрощенных подходов и принимать важные решения на основе вдумчивости, здравого смысла и экспертизы.

*Дуглас Арнольд является Макнайтовским (McKnight) президентским профессором математики в университете Миннесоты и президентом Общества промышленной и прикладной математики (Society for Industrial and Applied Mathematics, SIAM). Кристин Фаулер – сотрудник математической библиотеки университета Миннесоты. Авторы выражают признательность Сьюзан Лори (Susan K. Lowry), которая разработала и поддерживала базу данных, использованную в этом исследовании, а также Молли Уайт (Molly T. White).